(서울=뉴스1) 박정환 문화전문기자 = 사이먼 J. D. 프린스가 딥러닝의 기본 개념부터 트랜스포머와 확산 모델까지, 핵심을 구조적으로 짚는 해설서를 펴냈다. 책은 관련 계통의 전공자 수준의 기본 지식을 요구한다.

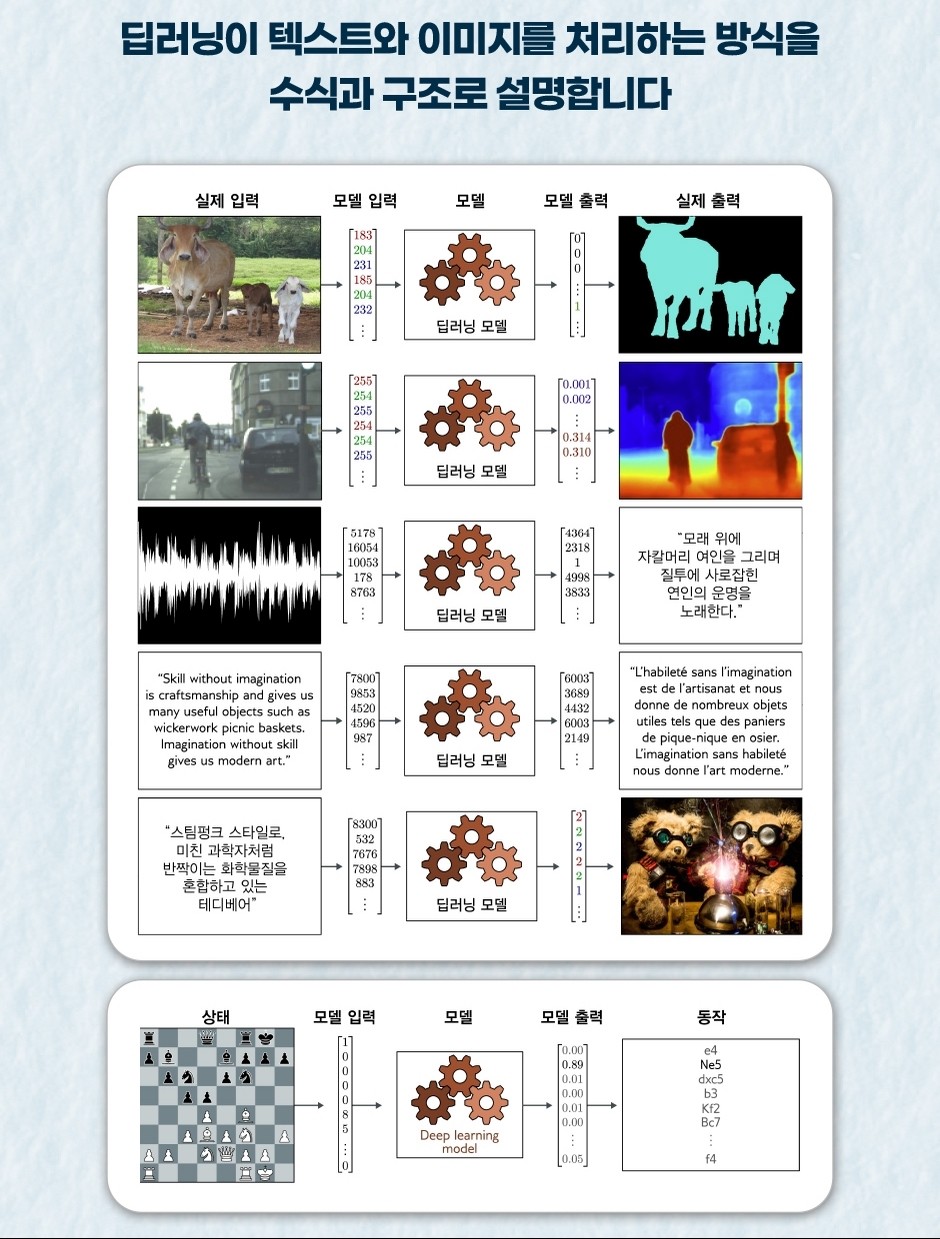

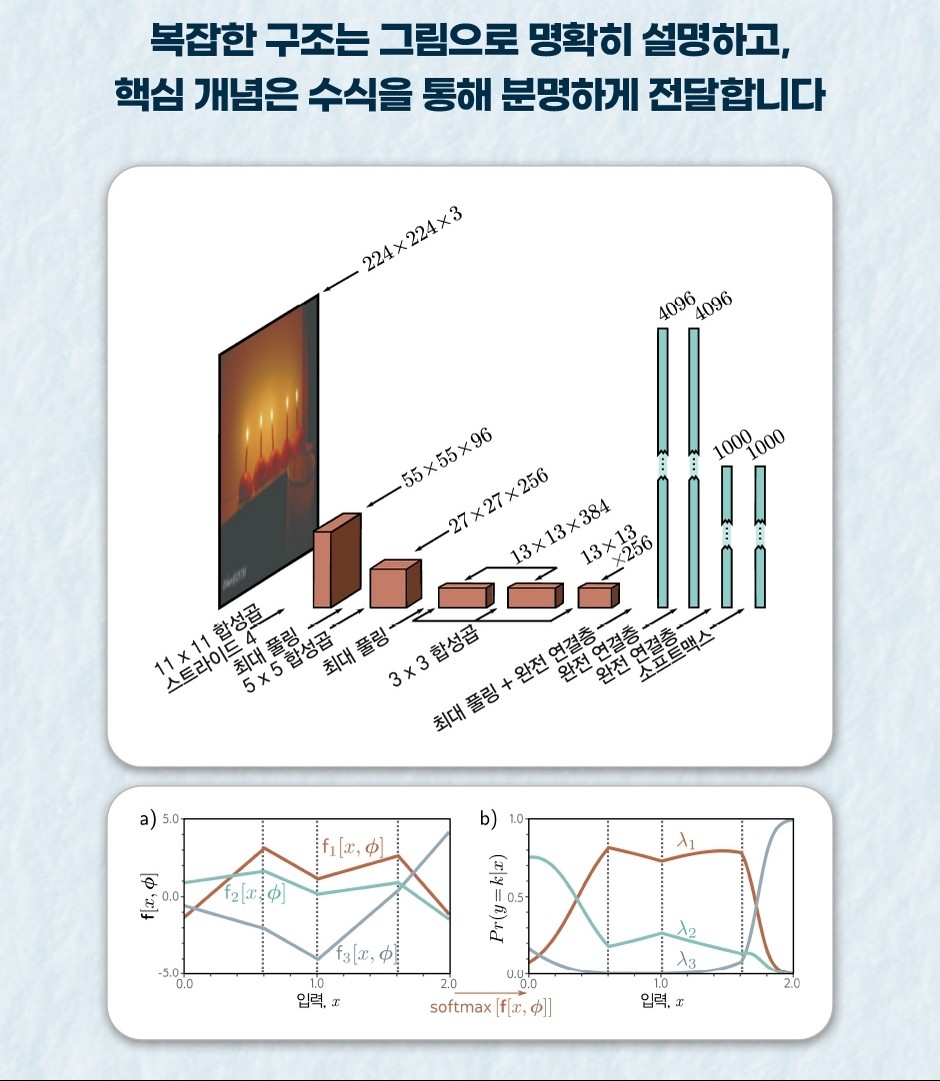

저자는 복잡한 구현 대신 왜와 어떻게에 초점을 맞춰 원리와 구조를 먼저 세운다. 지도/비지도/강화 학습의 큰 맥락을 깔고, CNN과 트랜스포머, 그래프 신경망으로 대표되는 현대 아키텍처를 이어 소개한다. 생성 모델과 윤리 논의까지 한 호흡으로 정리해 기초를 단단히 만든다.

책은 21장으로 나뉜다. 저자는 1장에서 지도/비지도/강화 학습을 간결히 정리하고, 책 전체의 학습 경로와 독서 방법을 제시한다. 입문자가 길을 잃지 않도록 개념 지도와 추천 도서를 함께 둔다. 이 장은 이후 각 장의 맥락을 설명하는 안내판 구실을 한다.

2~9장은 지도 학습 파이프라인을 처음부터 끝까지 따라간다. 선형회귀에서 시작해 얕은 신경망과 심층 신경망을 비교하고, 손실 함수와 최적화, 초기화와 역전파, 과소/과대적합의 진단과 정칙화, 성능 평가와 하이퍼파라미터 선택까지 한 흐름으로 엮는다. 실전에서 막히는 지점을 사례로 짚어 해결 전략을 제시한다.

10~13장 구조로 배우는 심층 네트워크다. 저자는 합성곱의 불변성과 등변성을 설명하고, 잔차 연결과 배치 정규화로 깊은 네트워크의 학습 문제를 다룬다. 이어 점곱 셀프 어텐션과 트랜스포머 층, BERT와 GPT 계열, 긴 시퀀스와 이미지용 변형, 그래프 신경망까지 이어 소개한다. 현대 모델의 공통 원리를 비교하며 쓰임새를 보여 준다.

14~18장은 생성 모델의 지형을 펼친다. 비지도 학습의 범주와 성능 정량화를 다룬 뒤, GAN과 정규화 흐름, 변분 오토인코더, 확산 모델을 순서대로 설명한다. 예측 신호의 설계, 안정화 기법, 잠재변수와 재매개변수화, 역과정 모델링 같은 핵심 아이디어를 통합해 보여 준다.

19장은 강화 학습의 최소 단위를 정리한다. 마르코프 결정 과정, 반환과 정책, 표 형식 방법과 Q 러닝, 정책 경사와 행위자-비평자, 오프라인 학습까지 이어진다. 지도 학습과 다른 목표함수 설계와 데이터 수집의 제약을 대비해 설명한다.

20장은 "왜 딥러닝이 효과적인가"라는 질문에 답한다. 적합 성능을 좌우하는 요인, 손실 함수의 지형, 일반화의 결정 요인, 매개변수 수와 깊이의 의미를 차례로 검토한다. 이중 하강과 그로킹, 복권 티켓 가설 같은 개념을 정리해 모델의 작동 이유를 개념적으로 조망한다.

21장은 윤리와 책임을 다룬다. 가치 정렬, 의도적 오용, 사회적/전문적 쟁점, 사례 연구, 책임 있는 AI 연구의 조건과 향후 과제를 정리한다. 기술이 사회와 만나는 접점에서 연구/산업이 지켜야 할 기준을 제시한다.

책은 증명이나 코드에 치우치지 않는다. 핵심 개념을 맥락 속에서 설명하고, 현장에서 부딪히는 난점을 사례로 풀어낸다. 입문자는 길을 찾고, 실무자는 설계의 이유를 재확인한다. "왜 이 구조가 통하는가"를 끝까지 묻는 태도가 전 장을 관통한다.

△ 딥러닝 제대로 이해하기 / 사이먼 J. D. 프린스 지음 / 고연이 옮김 / 제이펍 / 3만 8000원